不懂「詠唱」也能生成AI圖片!Midjourney超狂新功能,直接讓AI反推提示詞

讓AI來幫你寫Midjourney指令?或是看看在Stable Diffusion生成的圖片源自哪些材料?如何以AI攻AI?

數位時代

作者:王珮羽

資料來源:The Generator、Decrypt、PCgamer

責任編輯:錢玉紘

讓AI生成圖像,這幾個月來一直都是網路社群熱門話題。有些人已經擁抱了人工智慧,認為這將是未來藝術的發展方向,在AI輸入指令這門「詠唱術」甚至也被視為相當需要技巧的管理學問。

但也還是有一派質疑AI的道德與合法性,因為許多用以訓練AI的圖片並沒有經過創作者授權。但如果這些問題也都可以讓AI解決?近期Midjourney發布了新的「描述(describe)」功能,只要輸入一張圖,讓AI來幫你寫Midjourney指令,或是看看在Stable Diffusion生成的圖片源自哪些材料。

Midjourney學會從圖片反推到文字,「詠唱」可以輕鬆學會

「描述」的功能最厲害的地方在於,上傳一張圖片,就可以轉換成文字,而這些字詞可以再輸入Midjourney生成全新、相關聯的圖片。簡單來說,Midjourney學會了從圖片反推到提示詞(prompt)。

Today we're releasing a /describe command that lets you transform images-into-words. Give it a shot! We think this tool will transform your liguistic-visual process both in terms of creative power and discovery.

— Midjourney (@midjourney) April 4, 2023

使用方式很簡單,在文字的區域中輸入/describe,就會出現一個拖放欄位,讓使用者可以上傳一張圖片,並轉換成四組英文字詞之後,讓使用者選擇最適合的,也可以讓使用者自行修改。

Midjourney的提示詞可以很簡單,也可以是自然語言。但是要產生最符合使用者所想的圖片,就必須使用特有的語法了,因為Midjourney的機器人不像人類那樣理解語法、句子結構或單詞。因此,/describe對於生成圖像的新手而言非常有幫助。

只不過,由於近日Midjourney推出最新版本v5湧入大量的新帳號,Midjourney暫停了免費帳號試用圖片生成服務。目前不知道何時才會再度開放免費帳號使用,如果要使用Midjourney需支付每個月約10美元的訂閱費用。

目前在Twitter上的測試結果看來,都有至少七成以上的相似度。

/describe output:

portrait of a senior man in a museum, in the style of captivating visual storytelling, moody tonalism, narrative-driven visual storytelling, picassoesque, gray, nostalgiacore, realist: lifelike accuracy, biedermeier –ar 10:13

Original (left)

/describe (right) pic.twitter.com/3Kj7a8qzv7— Nick St. Pierre (@nickfloats) April 3, 2023

有些Twitter網友認為,這是一個學習如何使用提示詞的實用方式:

也有網友透過修改/describe生成出來的文字,來調整不那麼滿意的圖片;雖然結果可能不完全是用戶想要的,但從圖像生成文字來描述已經是一大突破:

What do you think?

— Nick St. Pierre (@nickfloats) April 3, 2023

Stable Attribution溯源AI「原形」,可以是AI與人類藝術共處的可能?

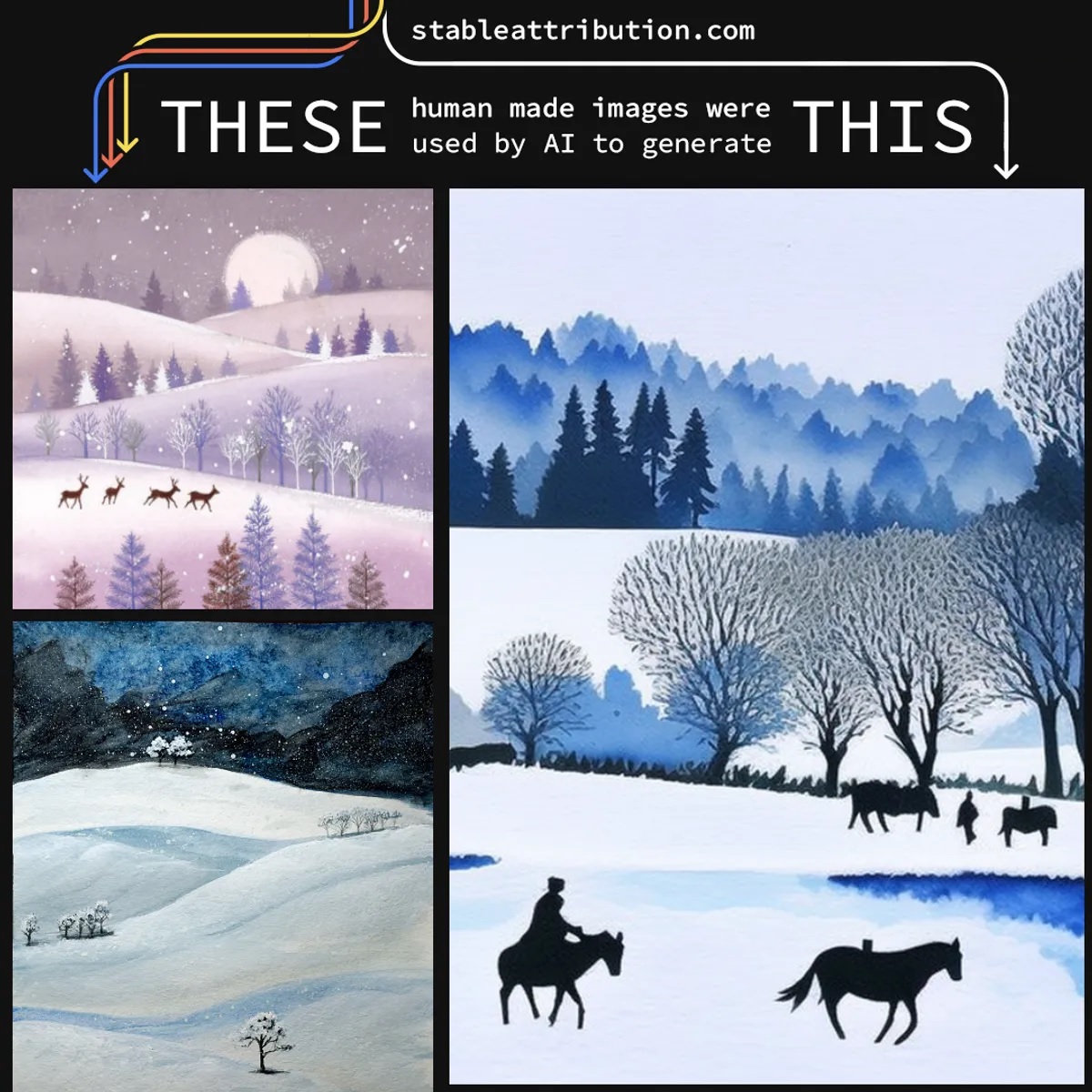

除了逆向生成文字,現在也有個網站逆向回推生成圖片的素材了。Stable Attribution(直譯為「穩定歸因」)名字與另一個AI圖片生成服務Stable Diffusion(直譯為「穩定擴散」)相對應,目的就是要找出一張AI圖像背後是哪些人類藝術家的作品。

該網站表示,希望提供原作資訊,讓大家正視人類藝術家對於AI藝術的貢獻。而找尋圖片素材來源的原理是將AI模型解碼,並在AI訓練的資料庫中找到最相近的圖片。而Stable Diffusion所使用的是資料庫LAION-5B是公開的,因此是目前該網站最主要可以溯源的AI圖像。Stable Attribution也開放用戶補充溯源到的圖片的作者和來源。

只要在該網站內上傳一張Stable Attribution生成的圖片,就會反向搜尋20張可能是AI參考後合成來的圖片。不過在上傳時該網站也表示,他們不會判斷上傳的圖片是否為AI。

事實上,AI生成一張圖的參考圖片可能不只20張,因此官網也提到,「目前第一版的Stable Attribution並不完美,部分原因是訓練過程嘈雜,訓練數據包含了大量錯誤和冗餘……但這也不是一個不可能解決的問題。」目前這個網站還在測試階段。

雖然還有AI圖像支持者質疑Stable Attribution炒作,或指出Stable Attribution給出的20張參考圖片都沒有上傳的AI圖像中的細節,但已經可說是一個開始,至少讓創作者能夠看到自己的作品是否會被當作AI的素材。

Getty Images等各大圖片網站與Stable Diffusion的版權爭議仍然還沒結束,但也有選擇加入AI潮流的網站,如近期與OpenAI合作的Shutterstock。在法律問題之外,Stable Attribution讓人看見了另一個AI與人類藝術共處的可能。

(原始連結)